«La degradación humana causada por la tecnología ha sobrepasado algunos límites importantes»

Lucía Blasco

BBC News Mundo

De tanto discutir sobre cuándo la tecnología iba a sobrepasar nuestras capacidades, perdimos de vista que las máquinas se estaban enfocando en conocer nuestras debilidades.

Es la base que sustenta un concepto que está resonando en Silicon Valley y que se conoce como human downgrading, «degradación humana» en español.

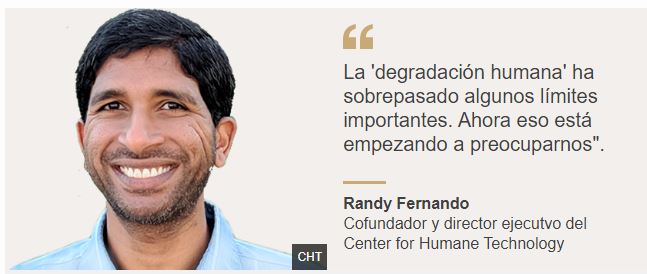

Fue acuñado por el científico informático Tristan Harris y su socio Randima (Randy) Fernando, cofundadores del Center for Humane Technology (CHT, Centro para la Tecnología Humana), una organización sin ánimo de lucro cuya misión es «revertir la degradación humana» y «realinear la tecnología con nuestra humanidad».

En el reciente documental de Netflix The Social Dilemma («El dilema de las redes sociales») Harris y Fernando exponen esta cuestión, estrechamente ligada a la llamada «economía de la atención», o cómo las empresas monetizan nuestra atención a través de las redes sociales y otras tecnologías digitales.

Fernando, director ejecutivo del CHT, cree que la tecnología debería ser «más humana». En esta entrevista con BBC Mundo explica por qué.

¿Cómo surgió tu interés en la economía de la atención y por qué te parece importante?

Mis padres me enseñaron mindfulness (meditación basada en atención plena) y tecnología desde muy pequeño, así que yo seguí esa trayectoria. Me interesé mucho en las gráficas computacionales y trabajé en Nvidia (una multinacional de Silicon Valley) durante siete años. Después ayudé a fundar una organización llamada Mindful Schools para enseñar mindfulness en las escuelas.

Hice eso durante un tiempo hasta que me topé con Tristan [Harris].

Los dos estábamos muy interesados en la atención plena (midfulness). Comenzamos a darnos cuenta de que estábamos en contra de cómo la economía de la atención compite constantemente para entrenar nuestras mentes de forma distinta.

La economía de la atención es una adversaria de la atención plena.

A las empresas les resulta muy fácil configurar perfiles sobre nosotros en base a la información que compartimos en las redes sociales, y comparten esa información con los anunciantes. Este modelo de negocio hace que nuestra atención se vuelva vital y además no se fundamenta en nuestros intereses, sino en los de los anunciantes.

Decidimos que lo mejor era crear una organización para gestionar el interés creciente en el tema (sobre todo desde que en 2017 Harris habló sobre ello en un programa de la televisión nacional) y tratar de abordar el problema.

Tres años más tarde, seguimos en ello.

Para abordar el problema ustedes proponen «revertir la degradación humana». ¿Qué significa eso?

Gran parte del trabajo que hacemos tiene que ver con la mente, con las adicciones y con cómo combatirlas; con la meditación y con el bienestar emocional. También con la democracia y la polarización, con la tergiversación de la verdad. Todos esos temas están interrelacionados y vinculados a la «degradación humana» (human downgrading).

Nosotros la describimos como algo cíclico: a medida que hemos ido mejorando y actualizando nuestras máquinas, hemos degradado a los seres humanos. Y debería haber sido al revés. Eso es algo que se repite constantemente.

Durante mucho tiempo, nos entusiasmamos mucho ante todas las mejoras tecnológicas, pero invertimos tanto esfuerzo y energía en el avance de la tecnología —que tanto nos ha beneficiado por décadas— que no prestamos suficiente atención a los cambios que se estaban produciendo en nuestro cerebro.

En un momento dado nos hicimos vulnerables a ella porque la tecnología puede usarse para aprovecharse de nuestras debilidades.

¿Qué ha cambiado en los últimos años para que este tema se haya puesto sobre la mesa dentro y fuera de Silicon Valley?

La «degradación humana» ha sobrepasado algunos límites importantes, por eso ahora está empezando a preocuparnos.

Vamos siendo conscientes de cómo las notificaciones tratan de «secuestrar» nuestra atención. Si los diseñadores lo usan a su favor pueden hacer que pasemos más tiempo en su producto, atraer nuestra atención para que nos fijemos en ciertos elementos a través de aspectos como el brillo de la pantalla y otros pequeños «trucos».

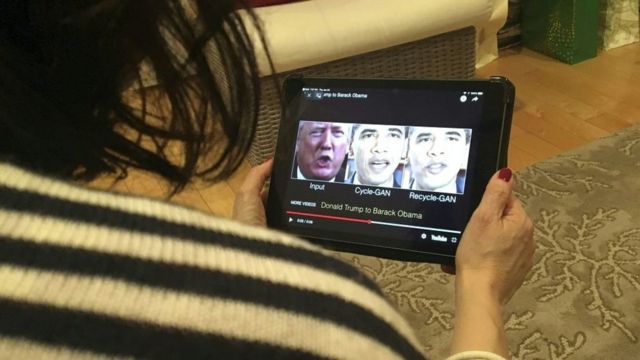

Y ya no sabemos qué es real y qué no. Los deepfakes (videos con personas aparentemente reales modificados con inteligencia artificial) son un buen ejemplo de ello.

La mente humana es limitada. Es maravillosa en muchos aspectos, pero tiene puntos débiles. Ahora que sabemos que la tecnología ha cruzado esa barrera, nuestro entusiasmo ha disminuido porque es algo que ya no podemos controlar.

Sin embargo, las fuerzas del mercado han seguido usando las nuevas tecnologías a su favor para incrementar las ventas. A los analistas les fascina buscar nuevas maneras de usar la tecnología a su favor y transformar esas tendencias en dinero. Pero quienes piensan en los beneficios no están teniendo en cuenta las consecuencias.

Eso está pasando en todo el mundo y a todos los niveles. Analistas, diseñadores de productos y gobiernos están compitiendo entre sí. Y al final termina siendo un arma muy peligrosa. Pero cada vez hay más reacciones en contra.

Lo dibujas como un sistema perverso. ¿Se pudo predecir de alguna forma?

Sí, claro que se predijo. Y no solo eso: también se buscó por parte de quienes quieren explotarlo a su favor. Una parte importante del problema es que quienes tratan de encontrar soluciones no suelen ser los mismos que quienes crean el problema.

Hay gente muy competente alarmando sobre el uso de la tecnología desde hace tiempo, pero quienes trabajan en los avances tecnológicos tienen otros incentivos y no les interesa aminorar la velocidad porque a menudo significa un perjuicio para ellos del que puede aprovecharse su competencia.

Por eso abordar este problema es tan complejo. A eso se suma que la «degradación humana» es cíclica.

¿A qué te refieres con que es cíclica?

Cuando nuestra atención se interrumpe repetidamente, nos distraemos más. Nos convertimos en la peor versión de nosotros mismos. La tecnología nos cambia. Y eso ocurre constantemente y cada vez más porque las redes sociales facilitan ese proceso.

Cuando competimos por la atención —likes, comentarios, shares— comenzamos a «decir» cosas distintas, a usar otro lenguaje. Publicamos fotos que llaman más la atención, somos más extremos cuando debatimos cuestiones políticas… todo eso beneficia a los algoritmos.

Al final del ciclo, la tecnología termina cambiándonos y, efectivamente, degradándonos. Y cuando nos hemos degradado, somos más vulnerables en el ciclo siguiente porque cuando estamos más distraídos es más fácil que ocurra un nuevo ciclo.

Termina siendo una carrera [de las empresas] por llegar hasta el fondo de nuestro tallo cerebral que saca lo peor de nosotros mismos y que cada vez incluye menos pausa, menos reflexión y menos meditación porque estamos ocupados reaccionando todo el tiempo.

Es fácil sentirnos impotentes ante esta situación… ¿qué podemos hacer?

¡Sin duda lo es! Es una parte tan importante de la economía… ¡Mueve billones de dólares! Pero podemos actuar en dos niveles: en primer lugar personal y en segundo, colectivo.

El primer paso empieza realmente por educarnos al respecto. En el plano personal podemos hacer cosas vitales como limitar las notificaciones, usar menos las plataformas digitales, cambiar lo que mostramos en ellas y nuestras interacciones en línea. Básicamente, entender cómo estamos siendo manipulados y actuar en consecuencia.

Además, está el plano colectivo. Por eso estamos creando un espacio para permitir que la gente exprese sus preocupaciones. Uno por uno no hacemos mucho, pero entre todos tenemos fuerza. Cuando nos unimos es cuando podemos provocar un cambio real. Esto es muy importante porque la «degradación humana» nos está cambiando como sociedad.

La pregunta es: ¿qué cambio queremos impulsar? Una de las claves es que el producto que usamos debe ser diferente, tiene que tener una codificación distinta. Y ese cambio se debe hacer desde dentro, pero la presión de consumidores, inversores, políticos, educadores y tecnólogos pueden favorecerlo.

Tenemos que cambiar las condiciones del juego. La tecnología que divide a la sociedad no es tecnología «humana» porque es dañina para los seres humanos.

¿Hasta qué punto dirías que estamos abriendo el camino hacia una tecnología más «humana»?

Para ser honesto, me sorprende favorablemente lo lejos que hemos llegado porque en un punto pensé que nos quedaríamos eternamente atascados en definir el problema.

Pero ahora, y en parte gracias a la repercusión que ha tenido [el documental] The Social Dilemma («El dilema de las redes sociales») —que sólo en el primer mes (septiembre) vieron más de 38 millones de personas— mucha más gente lo entiende.

Por suerte, cada vez más personas se están dando cuenta de cómo la información que comparten en las redes se favorece la economía de la atención. Eso es muy importante.

Una de las cosas más maravillosas de que haya tanta gente preocupada sobre este tema es que realmente podemos hacer fuerza para abordarlo. Cada vez más empresas y países están tomando medidas y yo veo oportunidades para el cambio a corto y medio plazo.

Ahora tenemos que seguir propagando el mensaje para que la tecnología sea cada vez más humana y nos permita conectar mejor, difundir la verdad y sacar la mejor versión de nosotros mismos.

Fuente:www.bbc.com